前回は「人工知能時代に本当に職業は無くなるのか?」というテーマでしたが、

今回も「人工知能と倫理」、旬のテーマです。

「自動運転車の事故が起こった場合、その責任はどこに帰属するのか?」

「人工知能搭載の鉄腕アトムのようなロボットが実現したとき、人間に危害を加えたときその責任はロボットに帰属するのか?」

技術に造詣が深くなくても、様々な問いが沸き起こります。

それに呼応して、社会においてもこのような試みが急速に進んでいます。

私達の哲学カフェではどのように追求することができるのか?

いつものFactory Art Museum Toyamaを会場として開催しました。

IT企業の経営者から公務員、そして人工知能を研究する大学生の方に至るまで、多士済々の参加者が集い語り合いました。

最初に、倫理とはなにか?を考えてみました。そのきっかけとして、倫理と道徳は何が違うのかについて対話しました。

倫理…社会的合意に基づく

道徳…個々人の良心に基づく

というざっくりとした定義付けに同意を得て、議論を進めました。

さらに、倫理学は主に下記の3つに分類されるという紹介をしました。

1.功利主義…ベンサムが言う「最大多数の最大幸福」に代表される

2.形式主義…カントが言う「格率」(基本的人権のような普遍的原則)

3.徳倫理学…アリストテレスの『ニコマコス倫理学』に代表される

1と2は対立関係で論じられることが多いですが、共に現代民主主義の基本原則になっていること、3は徳治主義のような考え方の基礎となっており、企業経営者に好まれる考え方であることを紹介しました。

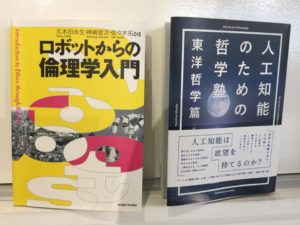

また、上記写真にある書籍についても紹介しました。

前者では、人工知能やロボットに責任を帰属するような記述は特になく、開発者への責任を促す議論がほとんどであること、そして後者では、ゲーム開発者であり哲学への造詣が深い筆者が意識自体への理解が深まり、それをプログラミングすることができるようになれば、人工知能に責任を問うことが可能になるが、それはまだまだのことであることを紹介しました。

自動車においては『自動車の社会的費用』で問われた責任を負う義務がありますが、いずれ人工知能にも課せられるときが来るのかもしれないという話題も上がっていました。その点では、人工知能をめぐる倫理学的議論はまだ始まったばかりで、ロボット三原則のレベルにも達していないわけです。

今回、様々な議論をして、人工知能が持つ社会的インパクトに比して、倫理的基盤が脆弱であり、倫理学的な議論が急務であることが改めて理解できました。

その一方で、人工知能は果たして意識や意思を持ちうるのかというベーシックな議論もまた大切であるということも理解できました。技術の進歩が意識を製造することが可能なのか?というSFのような問いに対して、哲学的に議論することが大事です。それに対して、十分に議論できたかというと必ずしも私は自信が持てません。

今後、また議論していきたいと思います。